Schlagwort: Klimawandel

-

Klima + Soziales = KlimaSocial

Liebe Webseite, es tut mir leid, aber ich habe ’ne Neue. Ich werde nun mehr Zeit mit meinem Angebot bei riffreporter.de/klimasocial verbringen. Dort schreiben einige Kollegen und ich darüber, wie wichtig die sozialen Prozesse sind, um den Klimawandel zu bewältigen. Nach dem Motto: Klima + Soziales = KlimaSocial. Der erste exklusive Artikel dort beschreibt die…

-

Klimatipps – nicht nur für Los Angeles

Zur Abwechslung mal ein paar Klimatipps für Haus und Grundstück. Der erste erreicht uns aus Los Angeles in Kalifornien, wo die vergangenen fünf Jahre der trockenste solche Zeitraum waren, seit das Wetter regelmäßig registriert wird – also seit 140 Jahren. Mehr noch: Eine Dürre wie 2012 bis 2014 sollte nur alle knapp 10 000 Jahre einmal…

-

Das Zeitalter der Pilzwolken

Am 25. Juli 1946 ließen die Amerikaner auf dem Bikini-Atoll im Rahmen der „Operation Crossroads“ den Sprengsatz Baker 27 Meter unter Wasser detonieren. 93 ausgemusterte und erbeutete Schiffe und viele Versuchstiere wurden der Explosion ausgesetzt. Sie fiel so unerwartet heftig aus und verursachte solche Schäden, dass die Organisatoren den geplanten dritten Test absagten und später…

-

Aerosole: Problem gelöst? Seite 2

Fortsetzung von Seite 1 Aus diesem wissenschaftlichen Erfolg entspinnt sich eine interessante forschungspolitische Diskussion, die ich in meinem SZ-Artikel nur anreiße, und hier vertiefen will. Bjorn Stevens, Direktor am Max-Planck-Institut für Meteorologie in Hamburg, verbindet sein Lob für die Ergebnisse aus der Schweiz mit einer Forderung, die den Autoren der Studien kaum gefallen dürfte. Da…

-

Paris und das Klima – im Großen und Kleinen

Paris geht heute einmal mehr in die Geschichte ein. Unter den Klimavertrag, der dort im vergangenen Herbst ausgehandelt wurde, setzen in New York bei den Vereinten Nationen die ersten Staaten ihre Unterschrift. Das Abkommen soll helfen, die Erwärmung der Welt tatsächlich auf zwei Grad Celsius zu begrenzen, womöglich aber auch auf 1,5 Grad. Der französische…

-

Wie die Bäume leichter atmen

Die Bäumchen wussten natürlich nicht, wie gut sie es eigentlich hatten. Während sonst überall noch Schnee lag, leuchteten die Setzlinge mit ihren flockenfreien Blättern bereits in vielen Grüntönen um die Wette. Acht Wärmestrahler an einem Gerüst über ihnen versetzten die Pflanzen sozusagen in die Zukunft – in eine Zeit, in der sich die Temperaturen wegen des…

-

Ei-enn-di-ssie

Der einzige Erfolg, den die internationale Gemeinschaft bei ihren Verhandlungen bisher erzielt hat, ist die sogenannte Zwei-Grad-Grenze (und es ist eine Grenze, kein Ziel). Im mexikanischen Cancún, im Jahr 2010, haben die Staaten beschlossen, dass eine Erwärmung bis 2100 gegenüber der vorindustriellen Zeit um diesen Wert gefährlichen Klimawandel darstellt. Und am Anfang des ganzen Prozesses,…

-

Welche Pause?

„Seepage“, das ist im Englischen ein technischer und geologischer Begriff, der etwas mit Ein- oder Durchsickern zu tun hat. Je nach den beteiligten Flüssigkeiten kann der Vorgang einigermaßen unappetitlich werden, und es ist anzunehmen, dass diese Assoziation Stephan Lewandowsky und Naomi Oreskes ganz willkommen war. Sie haben den Begriff nämlich ins Feld der Wissenschaftsgeschichte übertragen.…

-

Der Klimawandel ist da, da und da

Bis vor kurzem haben Klimaforscher diese Frage gehasst: „Ist das schon der Klimawandel?“ Wenn Wälder brannten, Städte glühten, Felder vertrockneten oder anschwellende Flüsse Dörfer versenkten, dann rief bestimmt jemand an und wollte das wissen. Und meist war dann die Antwort: Es ist unmöglich, für ein einzelnes Extremereignis genau anzugeben, was es ausgelöst hat – oder…

-

Wo das Meereis bleibt

Auf Spitzbergen hat der Klimawandel kurz der Jahrtausendwende richtig angefangen. Der Osten der Inselgruppe war bis dahin fest im Griff des Meereises. Wenn es dort 15 eisfreie Tage im Jahr gab, war das schon eine Ausnahme; mehr als 50 kamen praktisch nicht vor. Das begann sich in den späten 1990er-Jahren zu ändern: Der Trend der…

-

Kabeljau am Ende

Wer den Klimawandel unterschätzt, kann offenbar weder Fische noch Fischer retten. Diesem Zweck sollten schließlich die strengen Quoten für den Kabeljau-Fang im Golf von Maine dienen, die 2010 erlassen und zuletzt 2013 erheblich verschärft wurden. Dennoch erholt sich die Population kein bißchen, stellen Forscher eines lokalen Forschungsinstituts fest. Inzwischen ist die Zahl der Fische auf…

-

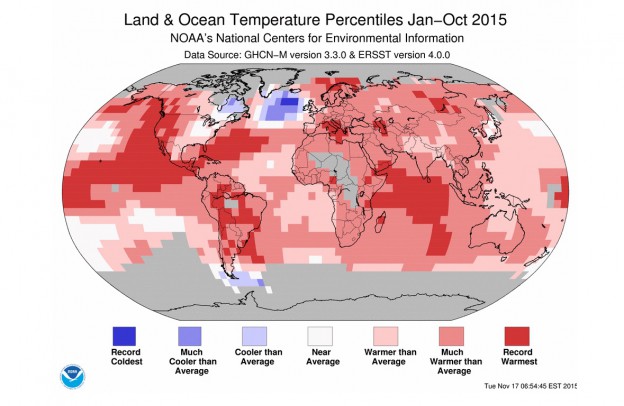

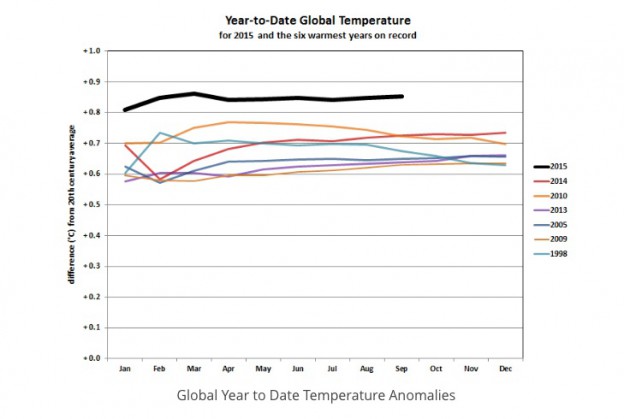

Wärme im Übermaß

Der September 2015 hat einen neuen Wärmerekord aufgestellt, meldet die US-Behörde für Ozean und Atmosphäre Noaa. Die Landmassen und alle Weltmeere zusammengefasst war die Erdoberfläche 0,9 Grad Celsius wärmer als der Durchschnitt über alle September im 20. Jahrhundert. In absoluten Zahlen zeigten die Thermometer in dem Monat statt der statistisch zu erwartenden 15,0 Grad eben 15,9…